只需 15 分钟iPhone 就能复制你的声音

史蒂芬·霍金的「机械电音」,也许是世界上其中一个最有辨识度的声音。

但那并不是霍金自己的声音。

到了今天,ALS 患者虽然有了更多语音合成的选择,但总体费用和时间门槛仍然不低,普及度也有限。

最近,苹果公布了全新无障碍功能 Personal Voice(暂未上线),不仅让用户能免费「备份」自己的声音,同时还在安全地应用 AI 技术上,作出了一次有意思的尝试。

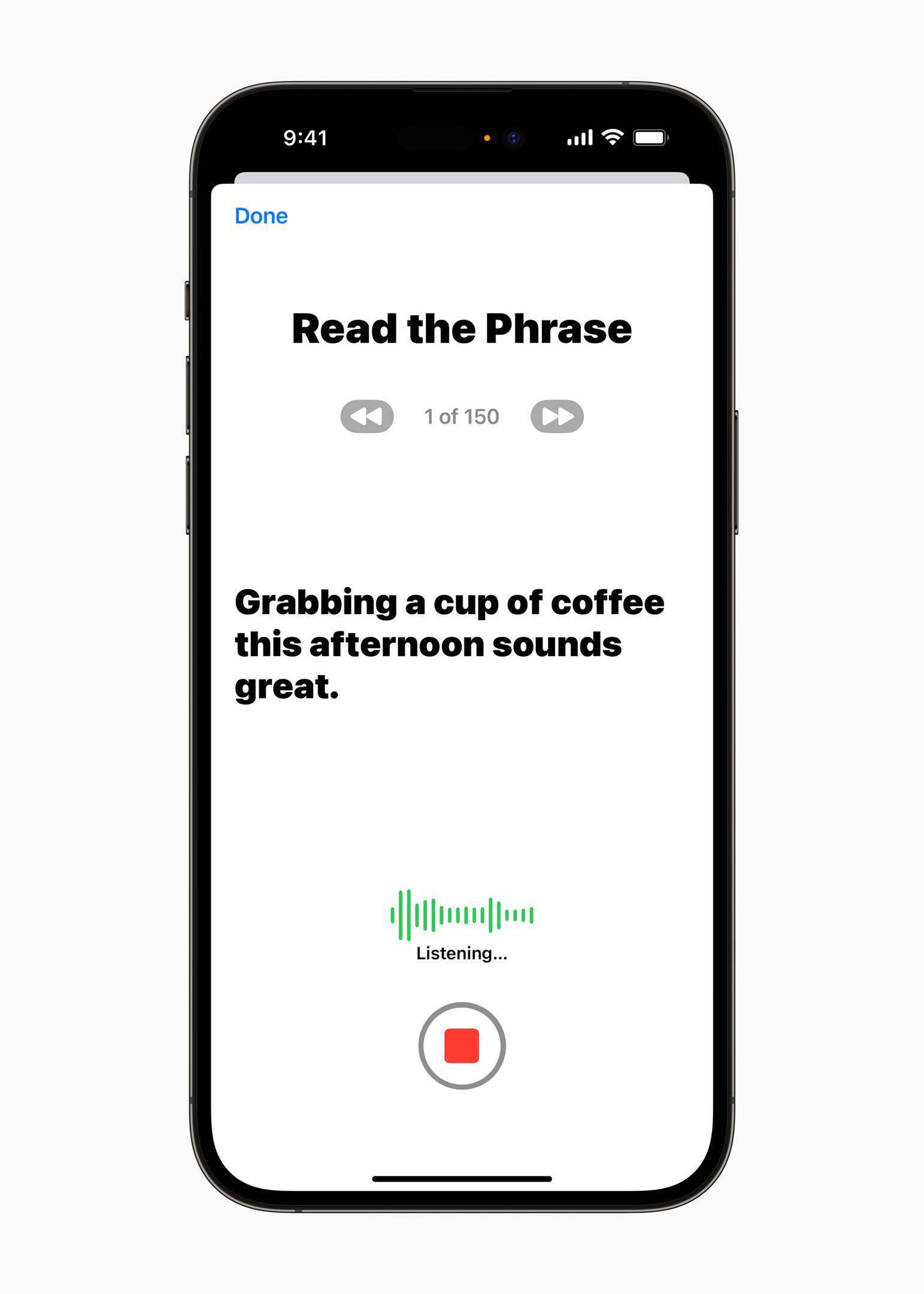

只需 15 分钟「调教」,就能生成你的声音

在生成式 AI 可以模仿一切的时代里,用 AI 模仿一个人的声音听起来已经不算新奇,只是感觉有点安全隐患。

我好奇的,更多是苹果要怎样安全和高效地实现 Personal Voice 这一功能。

据介绍,iPhone、iPad 和 Mac 用户只需要根据提示录制 15 分钟的音频,苹果就会基于设备端的机器学习技术来生成和用户一样的声音。

相比之下,为失语群体提供专业语音合成服务的公司,可能需要采用专业设备,录制几小时的语音素材,价格最低都要数百美元。

另一项新无障碍功能 Live Speech,则支持用户打电话、FaceTime 或者是和他人面对面对话的时候,输入文字即可生成语音内容,为失语或不方便说话的用户提供另一种「发声」方式。

用起来是方便了,但怎样避免有人用网上扒的语音素材来生成他人的声音?

素材随机化。

在录制 15 分钟语音素材的过程中,苹果将随机生成需要用户朗读的内容,减少他人猜中素材的可能性。

在录制过程中,用户需要在距离设备 6-10 英寸(约 15- 25 厘米)的特定空间里完成录制。

在生成过程中,所有数据都将通过苹果的 Neural Engine(神经引擎)在设备本地完成,不必要上传到云处理。

语音合成后,第三方应用如果想使用 Personal Voice,都要获得用户明确授权。

如果是苹果「全家桶」用户,生成自己的 Personal Voice 后还能通过 iCloud 同步到不同设备上,并以端对端的方式加密。

自己的声音,失去了才懂多重要

有研究指出,当人在听到母亲的声音时,身体释放出催产素水平和跟妈妈拥抱时产生的程度很相似。另一个研究则指出,听到自己的声音,会增强一个人的自我能动性。

这听起来有点抽象。

但当我们失去它时,重要性就变得显而易见了。

2021 年 3 月,Ruth Brunton 被确诊 ALS。那年圣诞,她就已经失语了。

ALS 患者中,约有 25% 的人患的是「延髓起病型」肌萎缩侧索硬化症,主要表现是说话障碍或吞咽困难。这类病人说话会逐渐变得含糊、带有鼻音,甚至失语。

Brunton 的行动很果断,确诊后马上找公司去做语音生成。

来回花了一个月时间,录了 3000 多个句子的语料,但最后出来的结果并不理想。

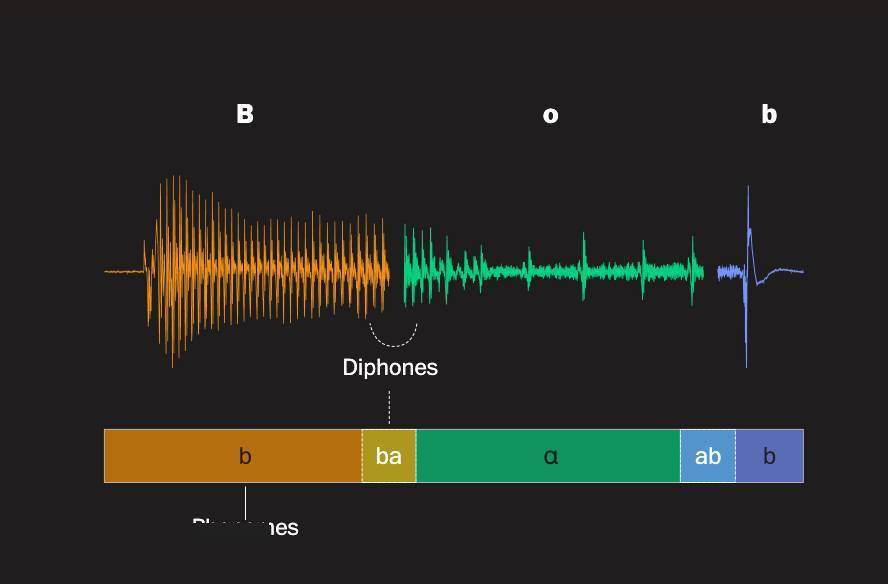

那家公司用的是一种名为「单元选择(unit selection)」技术。

简单粗暴来说,它就是通过「拼接」来实现语音生成,把语料拆分为大量小的语音单元,然后按需把元素拼起来。

这种技术生成的语音能听清,但会有点电音,听起来不太自然。

结果就是,Brunton 录制的语料结合了微软一个名为「Heather」的声音,不但声音和自己毫不相似,甚至逼着这英国人「讲」起了美语口音。

困在这个声音里,Brunton「只会在必要的时候说话,不再是因为想说话而说话」。

从前和丈夫打闹聊天的心情消失了,Brunton 也不怎么愿意参加多人对话。

即便是说「我爱你」,用一个不像自己的声音来说,意义也似乎被削弱了。

这听起来也许有点傻,但重新获得自己的声音让我更有自信了。

在波士顿儿童医院负责「增强沟通」项目的 John M. Costello 留意到,那些采用了更真实生成语音的病人,似乎更能够和亲近的人建立深厚的联结。

2022 年圣诞节,「重获新声」的 Brunton 还用语音录制的一段节日祝语。

然而,圣诞刚过,Brunton 就染上了新冠,最后在今年 2 月离世了。

她离开的那晚,丈夫 David 一整夜都握着她的手:

我们有两年时间来告别。

我们说好了,我们要说尽一切我们想说的。

难以想象,如果 Brunton 后来没换上更像自己的声音,她又是否能自在地说出想说的一切。

无障碍思维点亮灵感,AI 燃起生产力

我们去到和自己有着截然不同生验的人面前,聆听更少被诉说的故事和体验,创造出我们之前没想象过,但却能对更多人友好的的新生活方式。

Personal Voice 能让失语的 ALS 患者重新获得自己的声音;也可以帮助在经历「刀片嗓」的我用自己的声音去和其他人对话;甚至,我也很难避免会去想象,是否应该用这为自己「备份」声音留给亲近的人,以免哪天自己会突然离世。

而 AI 技术,就是实现这些想象力生产力。

正如杜编辑之前说的,虽然不赶生成式 AI 的热闹,但苹果一直都把 AI 用来提升用户体验 —— 提升效率,保护隐私。

除了 Personal Voice 以外,苹果这次预览的另一个无障碍功能 Point and Speak 也采用了本地设备端的机器学习技术。

未来,视障用户在 iPhone 自带的放大器里,结合 Point and Speak 和旁白功能,就能凭自己手指把 iPhone 变成「点读机」—— 点到哪儿,让 iPhone 给你把文字读到哪儿。

去年的「门检测」功能道理也类似,让设备端的机器学习帮视障用户识别出门,并朗读出门上面的信息和周围的标识。

这在无障碍设计方面也尤其重要 —— 因为这些功能设计起源就是服务被所谓「常规设计」忽略的人,常常都是更弱势的群体,因此更有必要确保这些用户的隐私不受侵害。

在这个语境下,我们也可开启更多关于数据应用权和透明度的讨论。

苹果这次做 Personal Voice 时,和帮助 ALS 患者的非盈利机构 Team Gleason Foundation 合作。

该机构的 CEO Blair Casey 一直也在推动语音生成公司设定一套标准录制素材设定,让用户能直接录这部分素材,并体验不同公司生成出来的语音效果,而不是像现在一样「盲赌」。

同时,Casey 也主张语音生成公司把用户录制的语音素材数据提供给用户(因为很多用户可能录制后就失语了),以免他们未来想把这些数据用在其他技术上:

如果更好的技术出来了,你会不想试一试吗?

如果你没法拿回自己的语音素材,你就没法去试。

AI 也许是我们时代最强的生产力。

但是,这力该怎么使,也许以人为本的无障碍设计能给它不少指引。